Открытый набор данных для тестирования Visual SLAM-алгоритмов при различных погодных условиях

https://doi.org/10.31854/1813-324X-2024-10-1-97-106

EDN: MHMJRS

Аннотация

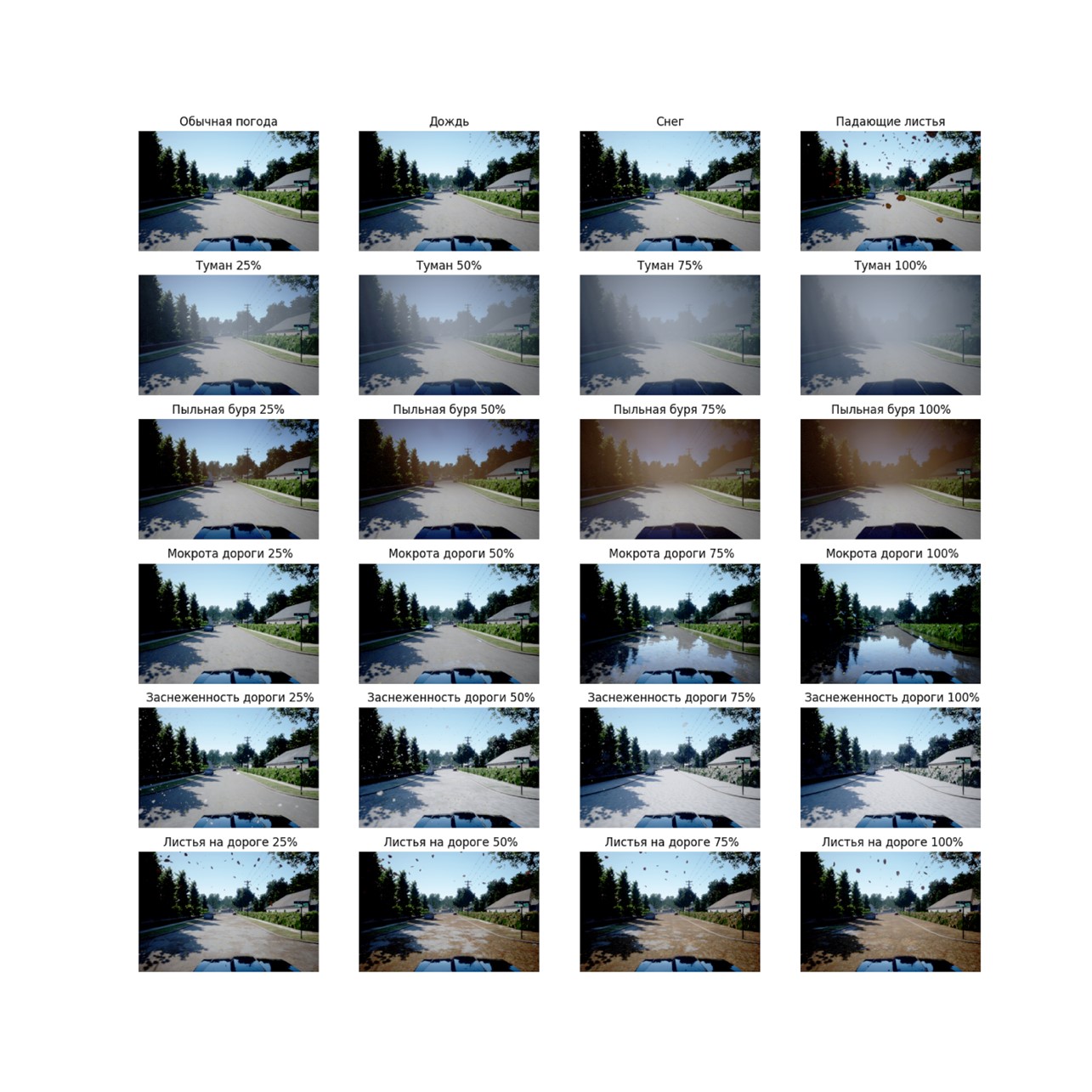

Существующие наборы данных для тестирования SLAM-алгоритмов в открытой местности не подходят для оценки влияния погодных условий на точность локализации. Получить подходящий набор из реального мира трудно из-за длительного периода сбора данных и невозможности исключения динамических факторов среды. Искусственно сгенерированные наборы данных позволяют обойти описанные ограничения, однако на текущий момент исследователи не выделяли тестирование SLAM-алгоритмов при различных погодных условиях как отдельную задачу, несмотря на то, что она является одним из аспектов различия между открытой и закрытой местностями. В данной работе представлен новый открытый набор данных, который состоит из 36 последовательностей движения робота в городской среде или по пересеченной местности, в виде изображений со стереокамеры и истинного положения робота, собранных с частотой 30 Гц. Движение в пределах одной местности происходит по фиксированному маршруту, последовательности отличают только климатические условия, что может позволить корректно оценить влияние погодных явления на точность локализации.

Ключевые слова

Об авторах

А. В. ПодтиховРоссия

аспирант лаборатории автономных робототехнических систем Санкт-Петербургского Федерального исследовательского центра Российской академии наук

А. И. Савельев

Россия

кандидат технических наук, старший научный сотрудник лаборатории автономных робототехнических систем Санкт-Петербургского Федерального исследовательского центра Российской академии наук

Список литературы

1. Olson C.F., Matthies L.H., Schoppers H., Maimone M.W. Robust stereo ego-motion for long distance navigation // Proceedings of IEEE Conference on Computer Vision and Pattern Recognition (CVPR 2000, Hilton Head, USA, 15 June 2000). Cat. No. PR00662. IEEE, 2000. Vol. 2. PP. 453‒458. DOI:10.1109/CVPR.2000.854879

2. Schubert D., Goll T., Demmel N., Usenko V., Stückler J., Cremers D. The TUM VI Benchmark for Evaluating Visual-Inertial Odometry // Proceedings of IEEE/RSJ International Conference on Intelligent Robots and Systems (IROS, Madrid, Spain, 01‒05 October 2018). IEEE, 2018. PP. 1680‒1687. DOI:10.1109/IROS.2018.8593419

3. Fischler M.A., Bolles R.C. Random sample consensus: a paradigm for model fitting with applications to image analysis and automated cartography // Communications of the ACM. 1981. Vol. 24. Iss. 6. PP. 381‒395. DOI:10.1145/358669.358692

4. Shah S., Dey D., Lovett C., Kapoor A. Airsim: High-Fidelity Visual and Physical Simulation for Autonomous Vehicles // Results of the 11th International Conference on Field and Service Robotics (Zurich, Switzerland, 12‒15 September 2017). Springer Proceedings in Advanced Robotics. Cham: Springer, 2018. Vol. 5. PP. 621‒635. DOI:10.1007/978-3-319-67361-5_40

5. Maddern W., Pascoe G., Newman P. 1 year, 1000 km: The oxford robotcar dataset // The International Journal of Robotics Research. 2017. Vol. 36. Iss. 1. PP. 3‒15. DOI:10.1177/0278364916679

6. Cordts M., Omran M., Ramos S., Scharwachter T., Enzweiler M., Benenson R., et al. The Cityscapes Dataset. URL: https://markus-enzweiler.de/downloads/publications/cordts15-cvprws.pdf (Accessed 18.01.2024)

7. Geiger A., Lenz P., Urtasun R. Are we ready for autonomous driving? The KITTI vision benchmark suite // Proceedings of IEEE Conference on Computer Vision and Pattern Recognition (Providence, USA, 16‒21 June 2012). IEEE, 2012. PP. 3354‒3361. DOI:10.1109/CVPR.2012.6248074

8. Engel J., Usenko V., Cremers D. A Photometrically Calibrated Benchmark for Monocular Visual Odometry // arXiv preprint arXiv:1607.02555. 2016. DOI:10.48550/arXiv.1607.02555

9. Chebrolu N., Lottes P., Stachniss C., Winterhalter W., Burgard W., Stachniss C. Agricultural robot dataset for plant classification, localization and mapping on sugar beet fields // The International Journal of Robotics Research. 2017. Vol. 36. Iss. 10. PP. 1045‒1052. DOI:10.1177/0278364917720510

10. Pire T., Mujica M., Civera J., Kofman E. The Rosario dataset: Multisensor data for localization and mapping in agricultural environments // The International Journal of Robotics Research. 2019. Vol. 38. Iss. 6. PP. 633‒641. DOI:10.1177/0278364919 841437

11. Minoda K., Schilling F., Wüest V., Floreano D., Yairi T. Viode: A Simulated Dataset to Address the Challenges of Visual-Inertial Odometry in Dynamic Environments // IEEE Robotics and Automation Letters. 2021. Vol. 6. Iss. 2. PP. 1343‒1350. DOI:10.1109/LRA.2021.3058073

12. Soliman A., Bonardi F., Sidibé D., Bouchafa S. IBISCape: A Simulated Benchmark for multi-modal SLAM Systems Evaluation in Large-scale Dynamic Environments // Journal of Intelligent & Robotic Systems. 2022. Vol. 106. Iss. 3. P. 53. DOI:10.1007/s10846-022-01753-7

13. Han Y., Liu Z., Sun S., Li D., Sun J., Hong Z., et al. CARLA-Loc: Synthetic SLAM Dataset with Full-stack Sensor Setup in Challenging Weather and Dynamic Environments // arXiv preprint arXiv:2309.08909. 2023. DOI:10.48550/arXiv.2309.08909

14. Dosovitskiy A., Ros G., Codevilla F., Lopez A., Koltun V. CARLA: An Open Urban Driving Simulator // Proceedings of the 1st Annual Conference on Robot Learning (PMLR, 13‒15 November 2017). 2017. Vol. 78. PP. 1‒16.

15. Campos C., Elvira R., Rodríguez J.J.G., Montiel J.M.M., Tardós J.D. ORB-SLAM3: An Accurate Open-Source Library for Visual, Visual–Inertial, and Multimap SLAM // IEEE Transactions on Robotics. 2021. Vol. 37. Iss. 6. PP. 1874‒1890. DOI:10.1109/TRO.2021.3075644

Рецензия

Для цитирования:

Подтихов А.В., Савельев А.И. Открытый набор данных для тестирования Visual SLAM-алгоритмов при различных погодных условиях. Труды учебных заведений связи. 2024;10(1):97-106. https://doi.org/10.31854/1813-324X-2024-10-1-97-106. EDN: MHMJRS

For citation:

Podtikhov A., Saveliev A. Open Dataset for Testing of Visual SLAM Algorithms under Different Weather Conditions. Proceedings of Telecommunication Universities. 2024;10(1):97-106. (In Russ.) https://doi.org/10.31854/1813-324X-2024-10-1-97-106. EDN: MHMJRS

JATS XML